Llama + Dify,在你的电脑搭建一套AI工作流

最近字节在推Coze,你可以在这个平台制作知识库、制作工作流,生成一个具有特定领域知识的智能体。

那么,有没有可能在本地也部署一套这个东西呢?这样敏感数据就不会泄露了,断网的时候也能使用AI。

刚好最近 Llama 3.1 发布了,本文就以 Llama 3.1 作为基础模型,配合 Dify 在本地搭建一套“Coze”。

跟着本文一步步操作,保证能行!

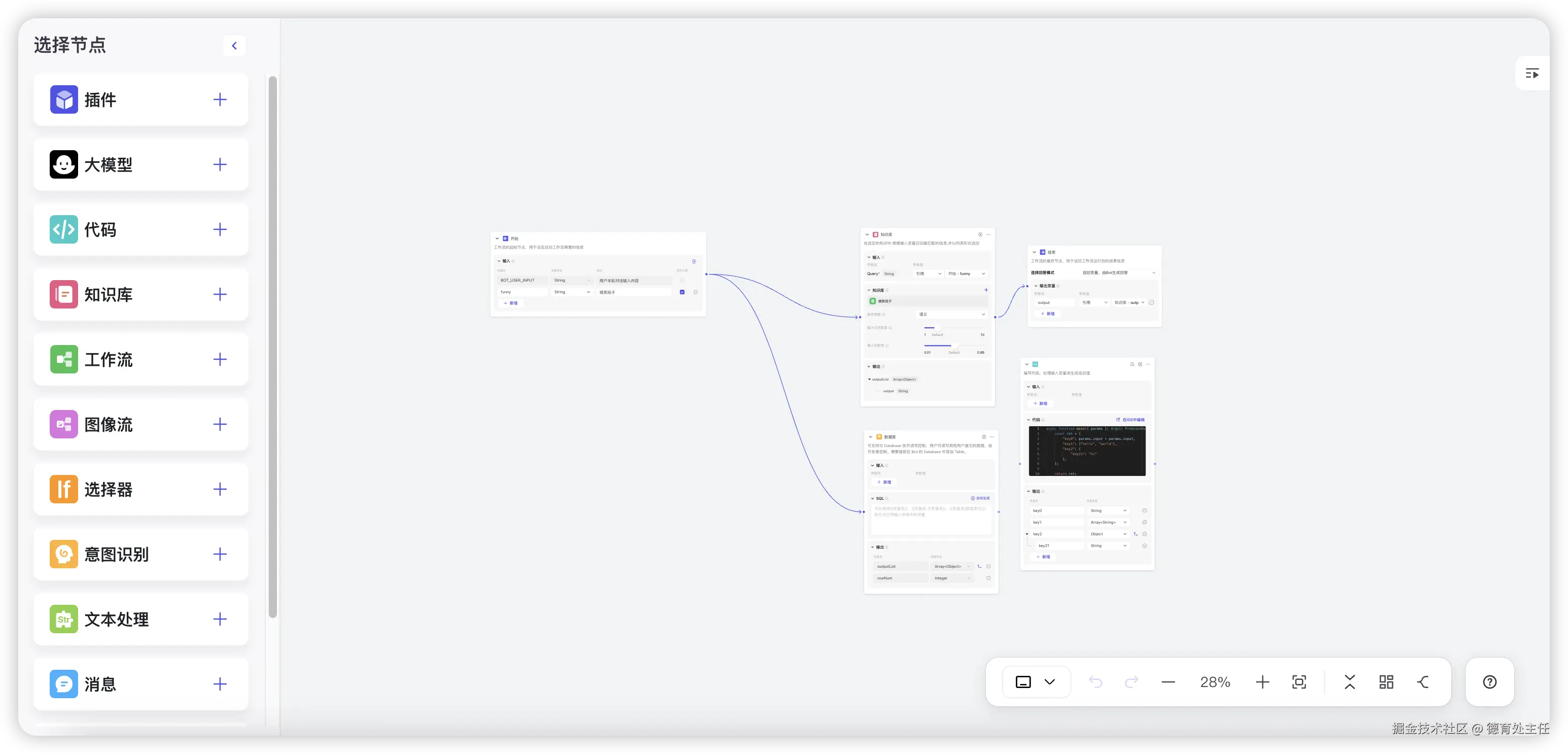

Dify是什么?

Dify 官网(difyai.com/) 的自我介绍:Dify 是开源的 LLM 应用开发平台。提供从 Agent 构建到 AI workflow 编排、RAG 检索、模型管理等能力,轻松构建和运营生成式 AI 原生应用。比 LangChain 更易用。

动手搭建

在本地搭建这个平台很简单,其实 Dify文档(docs.dify.ai/v/zh-hans) 里都写得明明白白了,而且还有中文文档。

具体来说需要做以下几步:

- 安装

Ollama - 下载大模型

- 安装

Docker - 克隆

Dify源代码至本地 - 启动

Dify - 配置模型

接下来一步步操作。

安装 Ollama

简单来说 Ollama 是运行大语言模型的环境,这是 Ollama 的官网地址 (ollama.com/ ),打开它,点击 Download 按钮下载 Ollama 客户端,然后傻瓜式安装即可(一直点“下一步”)。

安装完成后就能看到一个羊驼的图标,点击运行它即可。

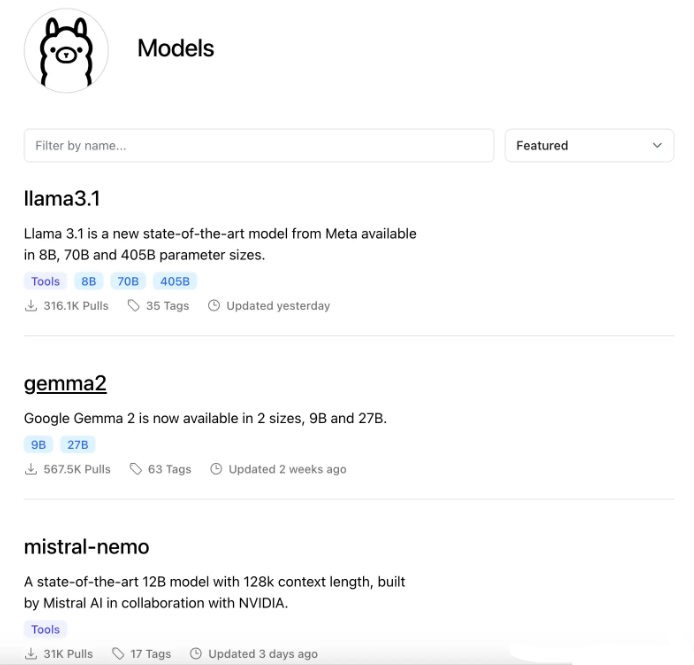

下载大模型

安装完 Ollama 后,我们到 Ollama 官网的模型页面(ollama.com/library)挑选一下模型。

这里面有很多开源模型,比如阿里的千问2,搜索 qwen2 就能找到它。

本文使用 Llama 3.1 ,这是前两天才发布的模型,纸面参数贼强。

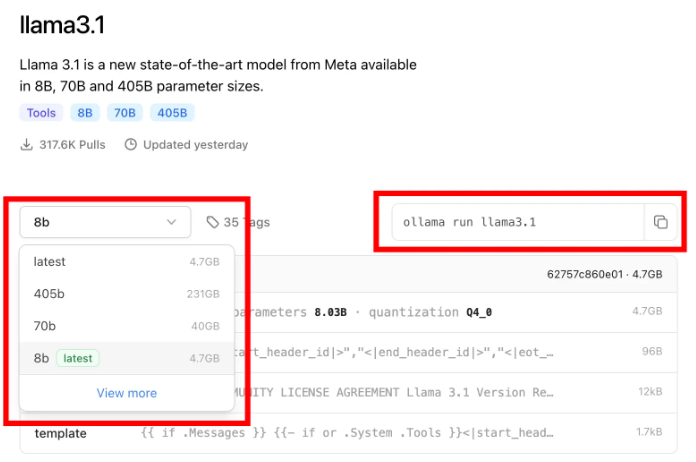

打开 Llama 3.1 模型的地址(ollama.com/library/lla…),根据你需求选择合适的版本,我选的是 8b 版。

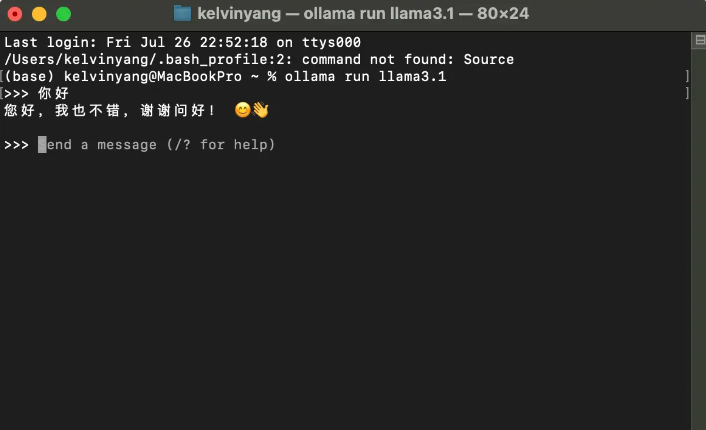

选好版本后,复制上图右侧红框的命令,到你电脑的终端中运行。

如果你还没下载过这个模型它就会自动下载,如果已经下载过它就会运行这个模型。

运行后,你就可以在终端和大模型对话了。

当然,我们不会这么原始的在终端和大模型对话,我们可是要搞工作流的!

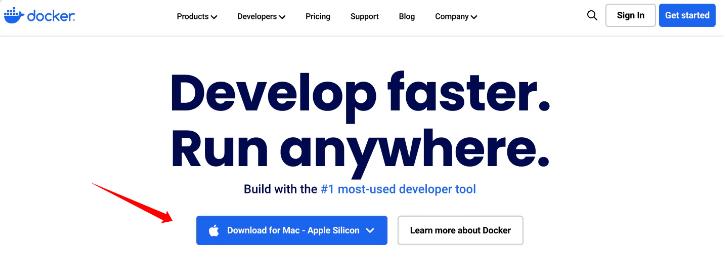

安装 Docker

前面的基础步骤都搞掂了,接下来就要开始为运行 Dify 做准备了。

先安装一下 Docker ,打开 Docker 官网(www.docker.com/),根据你系统下载对应的安装包,然后还是傻瓜式安装即可。

克隆 Dify 源代码至本地

要使用 Dify ,首先要将它拉到你电脑里。

git clone https://github.com/langgenius/dify.git

在你电脑里找个位置(目录),用 git 将 Dify 克隆下来,用上面这条命令克隆就可以了。

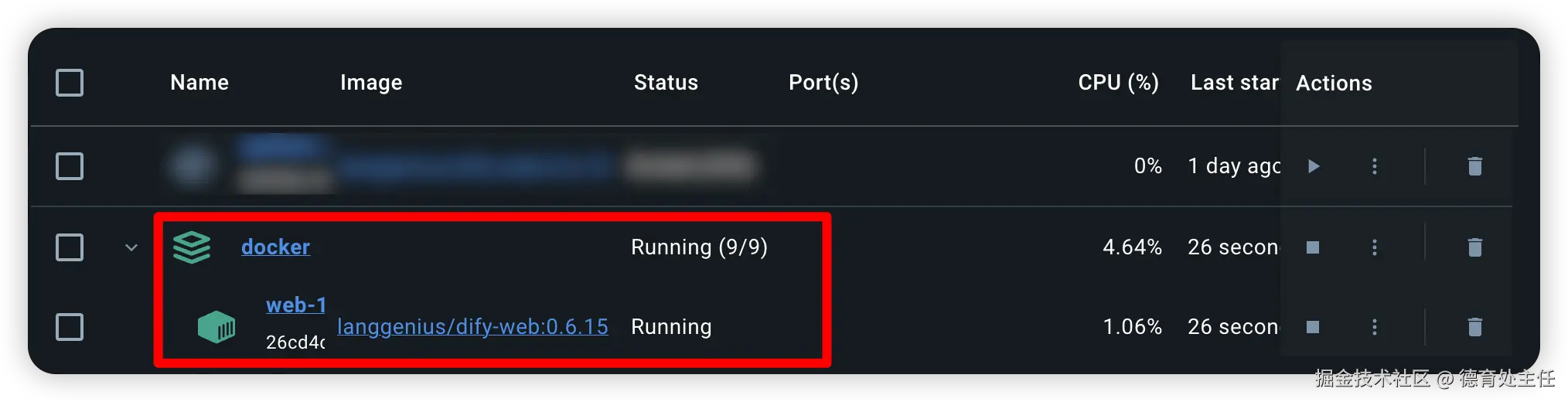

启动 Dify

进入 Dify 源代码的 docker 目录,执行一键启动命令:

cd dify/docker

cp .env.example .env

docker compose up -d

启动完成后,你的 docker 里就会看到这个

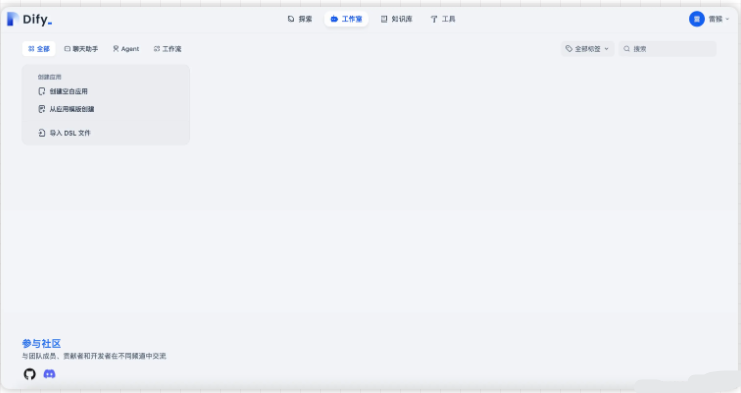

此时你在浏览器输入 http://localhost 就能看到这个界面。

首次打开 Dify 需要你设置一下管理员的账号。

然后用管理员账号登录,可以看到下面这个页面。

点击“创建空白应用”就可以创建聊天助手、文本生成应用、Agent、工作流。

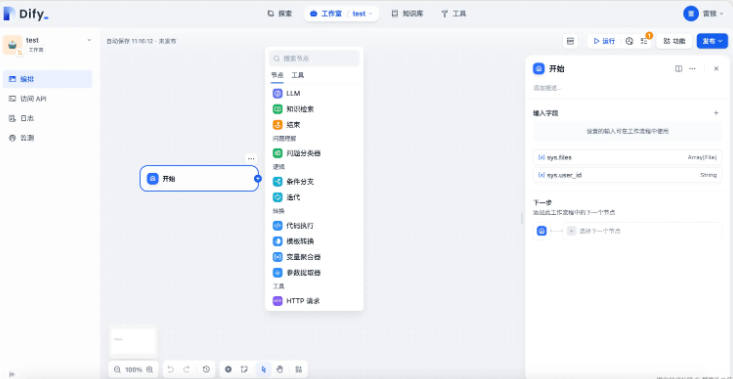

我们点击"工作流"就能看到类似Coze的工作流编辑界面了。

配置模型

在配置工作流之前,我们需要给 Dify 配置大语言模型。

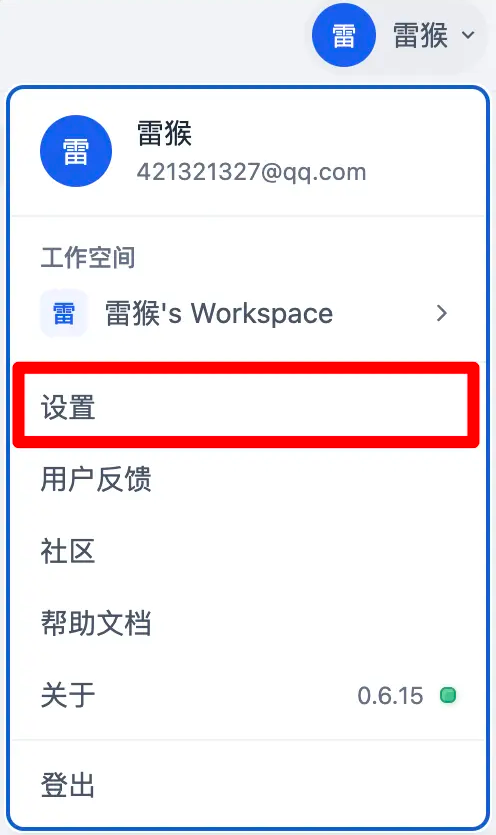

点击页面右上角的管理员头像,然后选择“设置”。

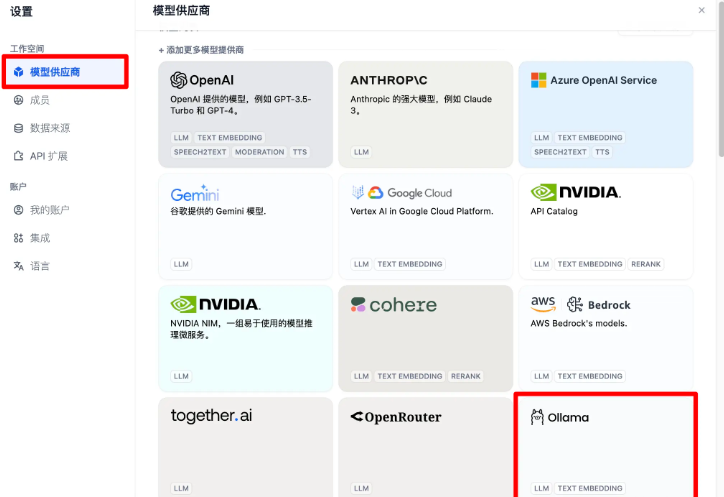

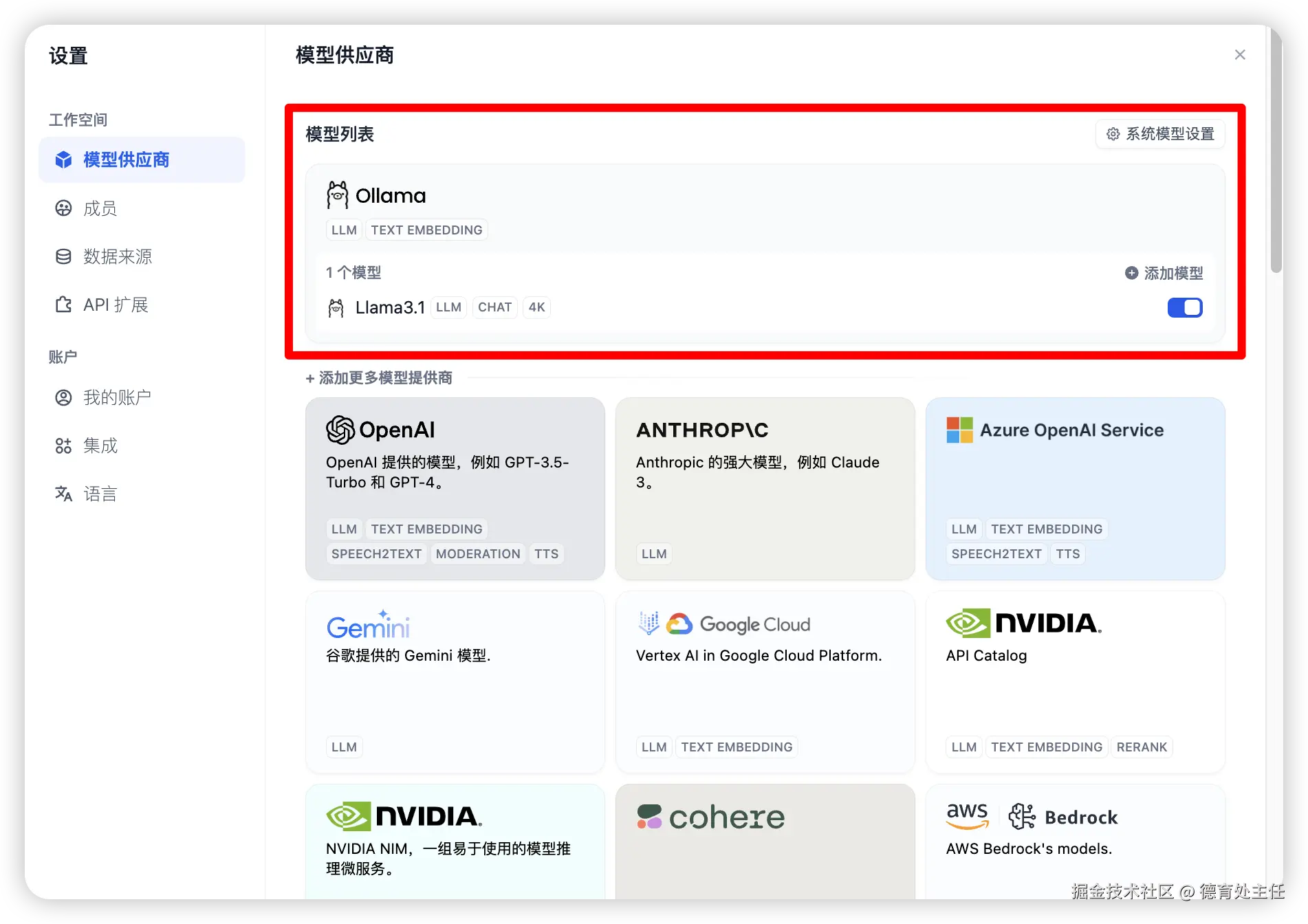

选择“模型供应商”,然后点击“Ollama”的卡片添加模型。

在添加 Ollama 模型时,弹窗的左下角有一个“如何继承 Ollama”的按钮,点击它会跳转到 Dify 官方文档教你怎么配置,但这里可能会有个小坑。

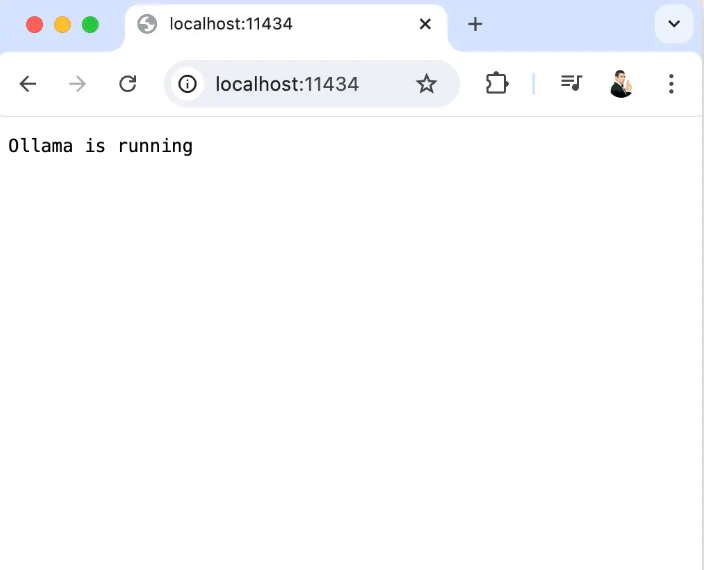

前面我们已经使用 Ollama 把 Llama 3.1 运行起来了,在浏览器打开 `http://localhost:11434 看到这个界面证明模型运行成功。

此时在“添加 Ollama”将资料填写好,“基础 URL”里输入 http://localhost:11434 即可。

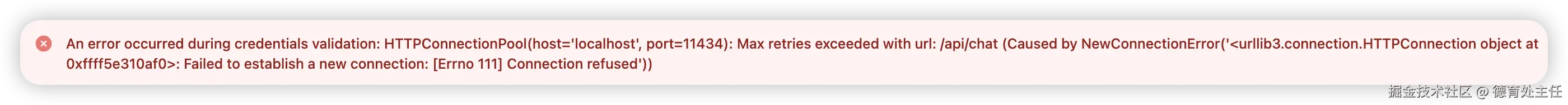

如果你是 Mac 电脑,填入以上资料有可能会报这个错:

An error occurred during credentials validation: HTTPConnectionPool(host='localhost', port=11434): Max retries exceeded with url: /api/chat (Caused by NewConnectionError('<urllib3.connection.HTTPConnection object at 0xffff5e310af0>: Failed to establish a new connection: [Errno 111] Connection refused'))

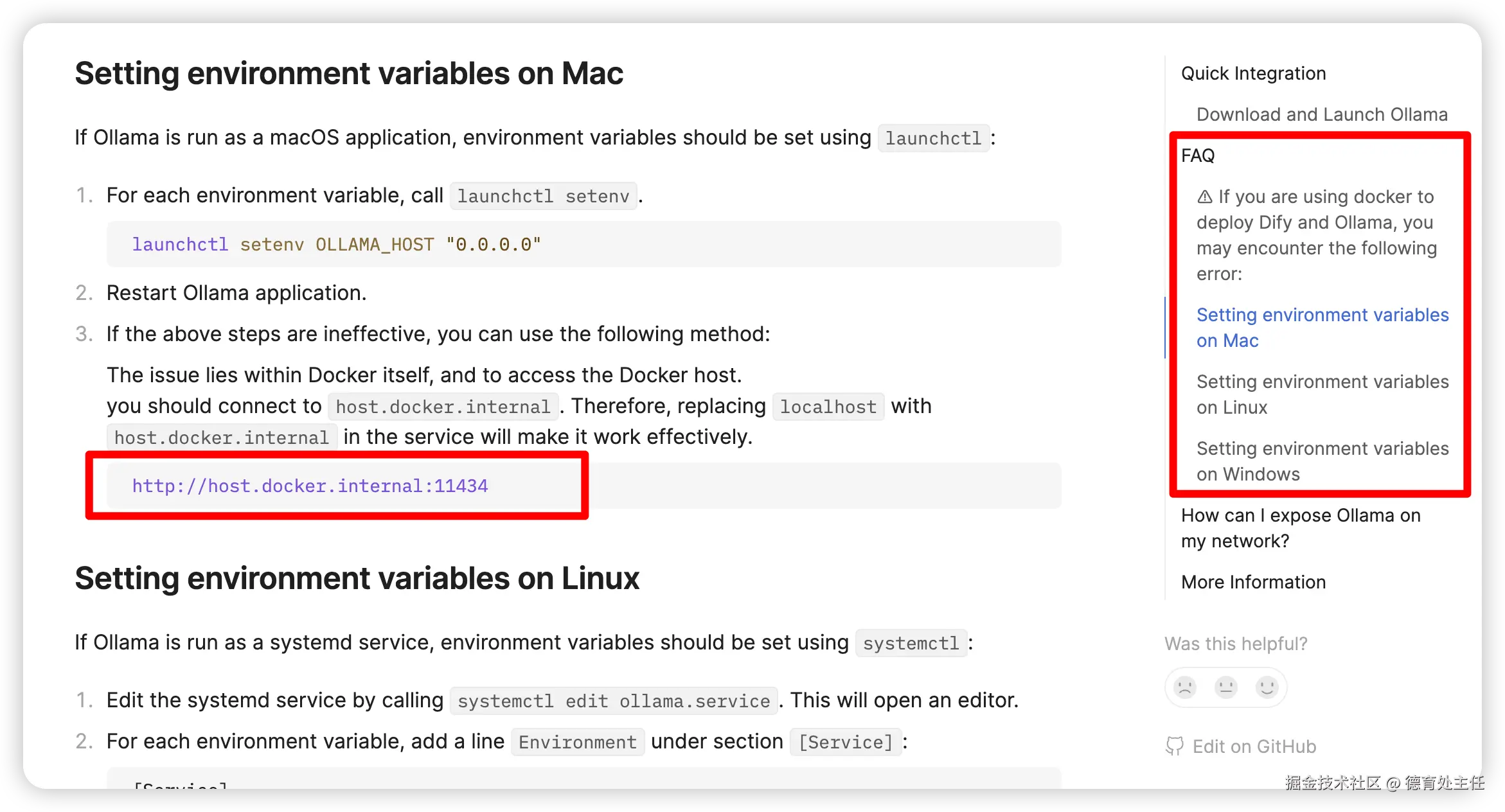

此时你需要在“基础 URL”里填入 http://host.docker.internal:11434。

遇到问题可以看 Dify 官方文档的 FAQ。

添加完成后你就可以在模型列表里看到它了。

除了接入 Ollama 外,Dify 还支持接入 OpenAI 等闭源模型,但需要你去 OpenAI 那边买个服务。

以上就是本文的全部内容啦,如果本文对你有帮助的话也请你分享给你的朋友~

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

原文地址:https://blog.csdn.net/python12222_/article/details/144770897

免责声明:本站文章内容转载自网络资源,如本站内容侵犯了原著者的合法权益,可联系本站删除。更多内容请关注自学内容网(zxcms.com)!