RFLA--F

文章目录

hh

源代码

Abstract

在本文中,作者指出对于微小目标来说,无论是基于锚的盒先验检测器还是无锚的点先验检测器都是次优的。作者主要观察到现在的基于锚或无锚的标签分配范式会产生许多离群的微小真值样本,导致呢检测器对微小目标的关注减少。

为此,作者提出了一个基于高斯接受野的标签分配策略用于微小目标检测

Introduction

对于基于锚点的检测器,先验框的离散位置,尺度和纵横比是启发式预设的。无锚检测器将先验从框变为点。

作者以个体先验盒和点为实例,从分布的角度对其进行重新思考

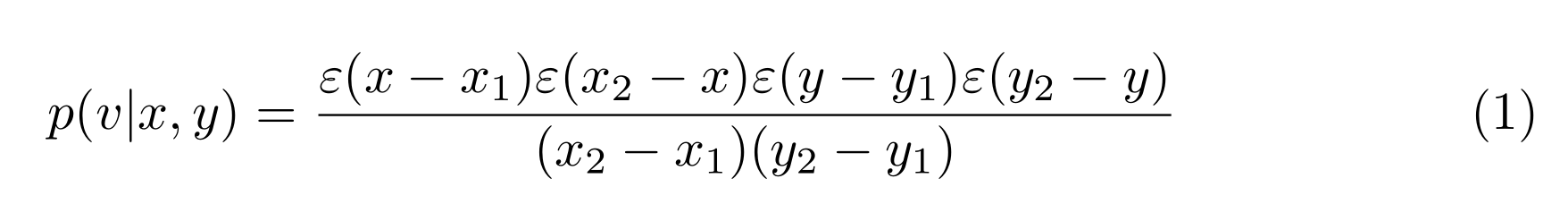

先验信息的概率密度函数如下,

该公式可以看出:

先验与gt必须有重叠,否则权重v=0,但对于微小物体来说,没有重叠却是很常见的,这就会导致微小物体缺乏正样本

v=constant,只要目标与gt有交集,任意位置的权重都相同,而研究表面有效接受野是服从高斯分布的…均匀分布的先验和高斯分布的接受野之间的差距将导致gt与分配给它的特征点的接受野之间的不匹配

为了缓解上述问题:作者引入了一个新的基于高斯分布的先验并且建立了一个基于高斯接受野的标签分配策略

具体来说,作者提出用新设计的感受野距离RFD来直接衡量高斯接受野和gt之间的相似性,利用高斯接受野作为先验可以很好的解决框先验和点先验带来的问题。

一方面:高斯分布不是阶跃变化的,每个位置的权重呢会从整个图像中间向边缘不断衰减但始终大于0。不存在必须与gt重叠的限制

另一方面:高斯先验可以更好地拟合高斯有效感受野的性质,从而缓解感受野失配问题

此外,RFD和IoU不是同一维度,因此以往的基于阈值的标签分配结构是不合理的,作者引入了特征点优先级按它们的RFD分数排序,基于RFD作者还设计了一个分层标签分配HLA进一步缓和离群值,获得足够训练的微小目标

本文贡献如下:

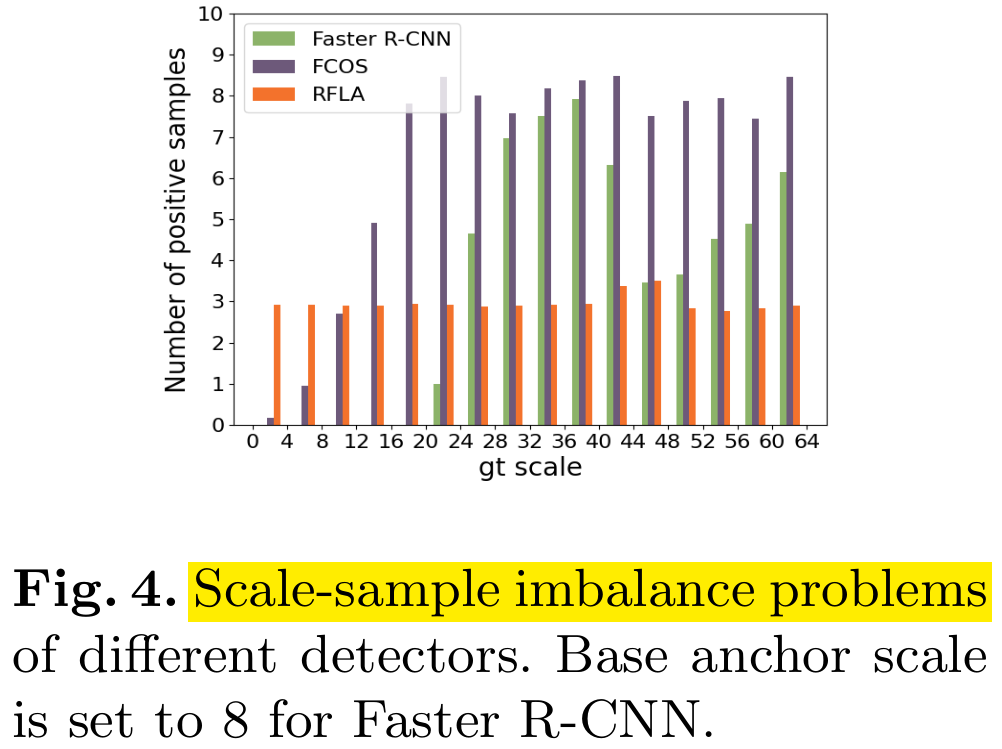

作者经验的揭露了现存的基于锚和无锚的检测器在微小目标标签分配上存在尺度样本不平衡问题。(数据集中不同尺度的样本数量分布不均衡)

为了缓解上述问题,作者引入了一种简单而有效的基于接受野的标签分配(RFLA)策略,RFLA很容易取代主流检测器中的基于盒盒点的标签分配策略,提高了它们在TOD上的性能

进行了大量实验验证了所提出的方法的性能优势

Related Work

Object Detection

基于锚点的范式的一个基本缺陷是它需要根据具体任务进行调整

Tiny Object Detection

现有的大多数微小目标检测方法大致可以分为以下四类:数据增强、多尺度学习、针对微小目标的定制训练策略和特征增强策略

Krisantal等人[18]试图通过对包含微小物体的图像进行过采样并复制粘贴来提高TOD性能,多尺度学习策略通常通过额外的计算来提高TOD性能。

作者提出的方法试图从标签分配的角度推进TOD,并且提出的策略在推理阶段不会带来任何额外的成本

Label Assignment in Object Detection

本文主要研究TOD的先验信息设计及其相应的标签分配策略

Method

感受野建模

主流目标检测器遵循的一个基本原则是分而治之

基于锚点和无锚点的检测器的一个共同点是为不同尺度的目标分配适当的接受野的特征点。因此,接受野可以直接作为标签分配的有根据和有说服力的先验。在本文中,作者提出直接测量有效感受野(ERF)与gt区域之间的匹配程度来进行标签分配

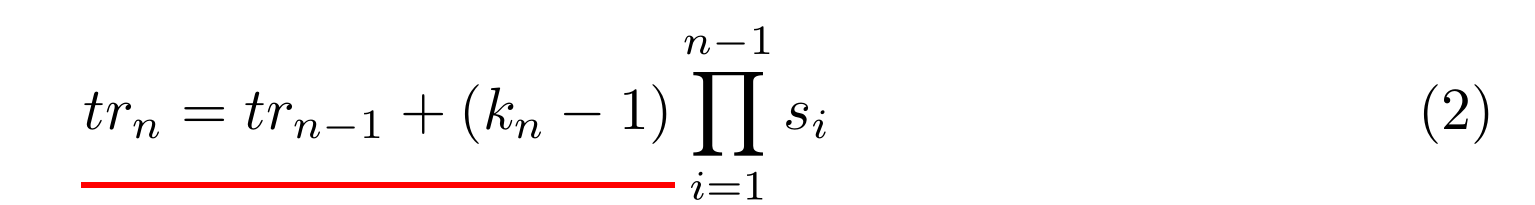

标准卷积神经网络上第n层的理论接受野trn如下:

其中kn盒si分别表示第n层的核大小以及步长

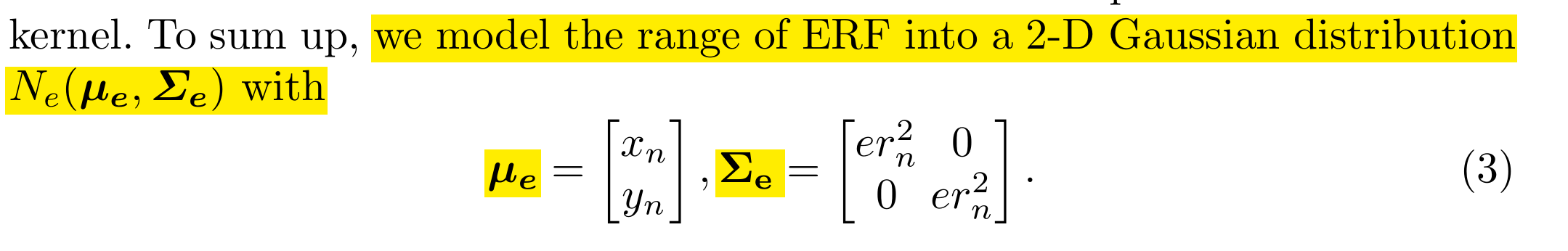

研究表明,ERF和TRF有相同的中心点,但每个特征点的ERF只占TRF的一部分,因此作者使用每个特征点(xn,yn)的位置作为二维高斯分布的均值向量,由于很难得到精确的ERF,作者将ERF半径ern近似为TRF半径的一半,ern的平方作为协方差

感受野距离RFD

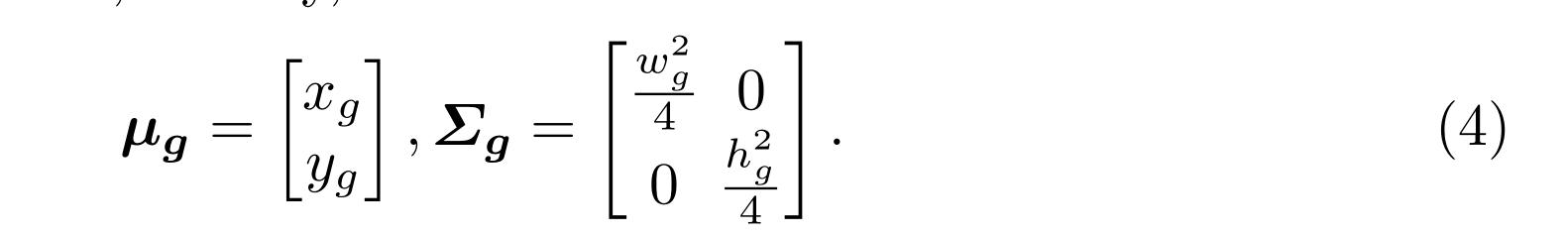

观察到目标的主体聚集在边界框的中心,将gt盒(xg,yg,wg,hg)建模为标准二维高斯分布Ng(μg,Σg)

作者研究了三种典型的高斯分布之间的距离作为接收野距离的候选(RFDC):Wasserstein distance , K-L divergence and J-S divergence。

由于高斯分布之间的J-S散度没有闭合解,在逼近其解时会引入巨大的计算量,因此排除

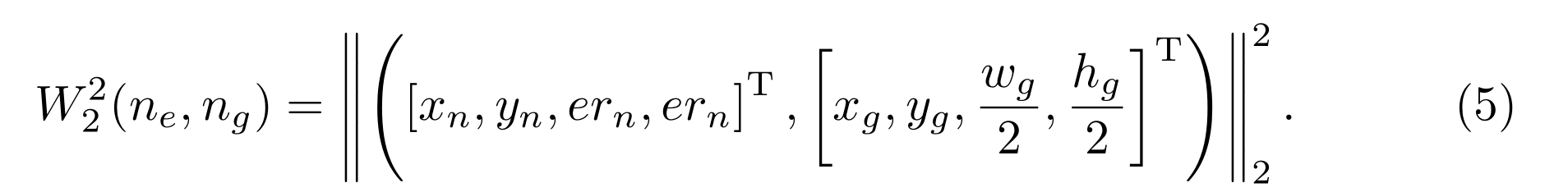

Wasserstein distance :

WD的主要优点是它可以测量两个不重叠的分布,但WD并不是尺度不变的,当数据集包含大规模方差的对象时,Wd可能是次优的

Kullback-Leibler divergence:

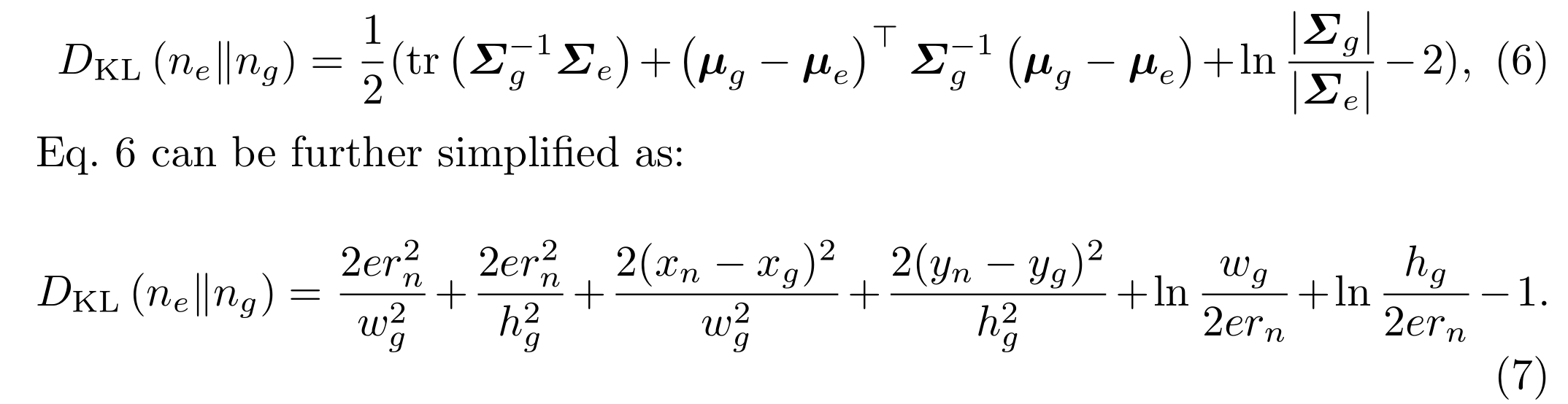

KLD是一个经典的统计距离,它测量一个概率分布与另一个概率分布的差异。两个高斯分布之间的KLD也有封闭形式解,ERF ne与gt区域ng之间的KLD如下:

显然,KLD在两个二维高斯分布之间具有尺度不变性。但当两个分布没有重叠时,KLD无意义

因此,作者选择选择Wasserstein距离和KLD作为RFDC。然后,对RFDC进行非线性变换,得到正规化值范围在(0,1)之间的RFD:

分层标签分配

由于在基于阈值和基于gt区域的策略中,微小目标通常都不受欢迎,作者提出通过分数排序分层地为微小目标分配标签。

为了保证任意特征点与任意gt之间的位置关系能够求解,在该RFD的基础上建立了分层标签分配(HLA)策略

在分配之前,根据上述方法计算特征点与gt之间的RFD评分矩阵

在第一阶段,我们对每个特征点的RFD得分进行一定的排序,然后对具有一定gt的RFD得分前k的特征点分配正标签,最终我们得到赋值结果r1和对应的已赋值特征的掩码m(0,1)。在第二阶段,为了提高整体召回率和缓解异常值,我们通过乘以阶段因子β来轻微衰减有效半径ern,然后重复上述排序策略,并为每个gt补充一个阳性样本,得到分配结果r2。我们根据以下规则得到最终赋值结果r:

将RFD与HLA策略相结合,可以得到完整的基于感受野的标签分配(RFLA)策略

检测器应用

对于Faster R-CNN, RFLA可以用来代替标准的锚点平铺和MaxIoU锚点分配过程;对于FCOS,RFLA消除了限制特征点在gt框内的约束。为了避免梯度爆炸,作者将中心度[46]损失修改为:

C是为避免梯度消失问题而设为0.01的因子

Experiment

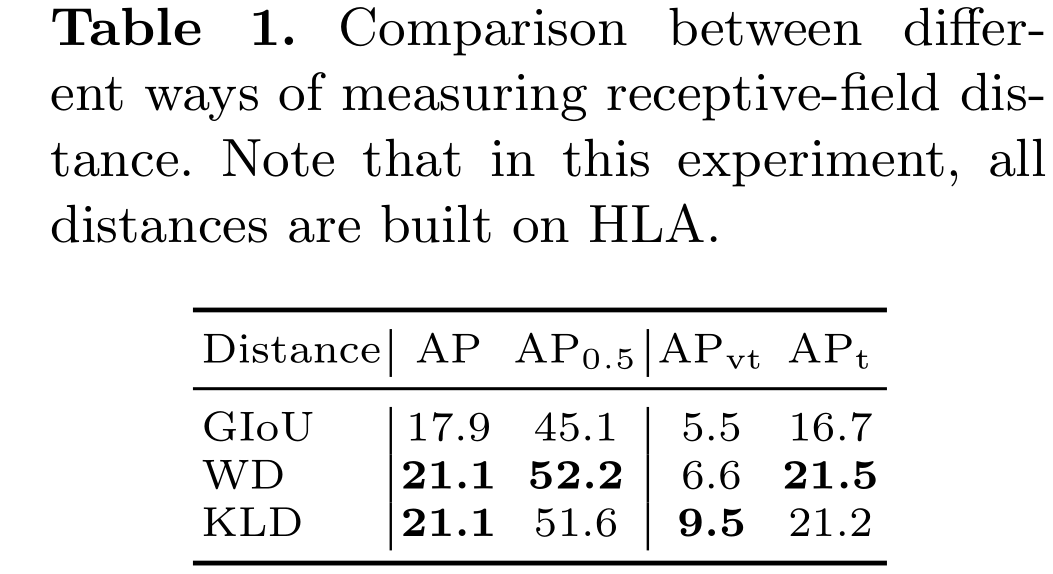

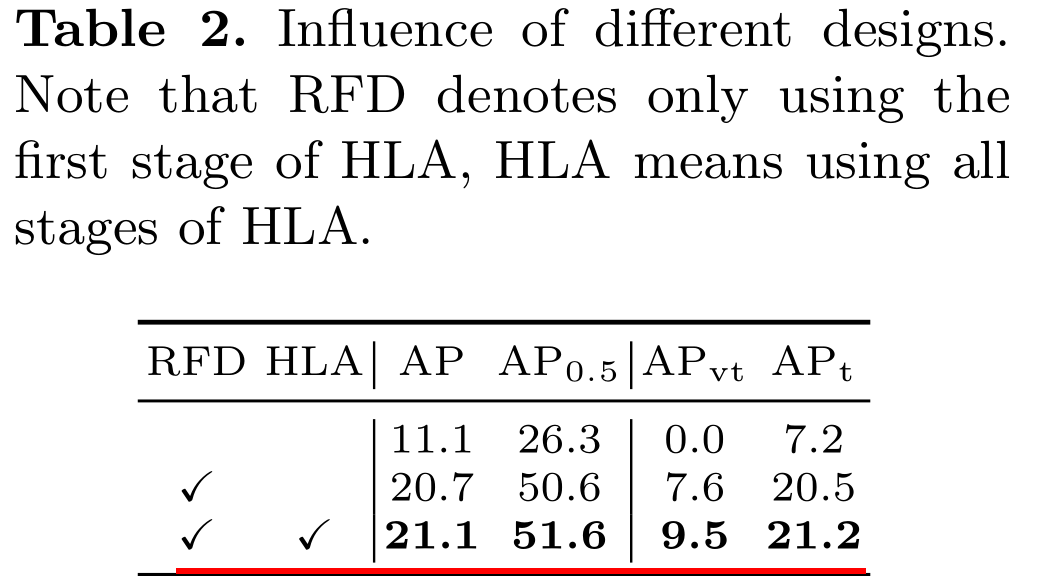

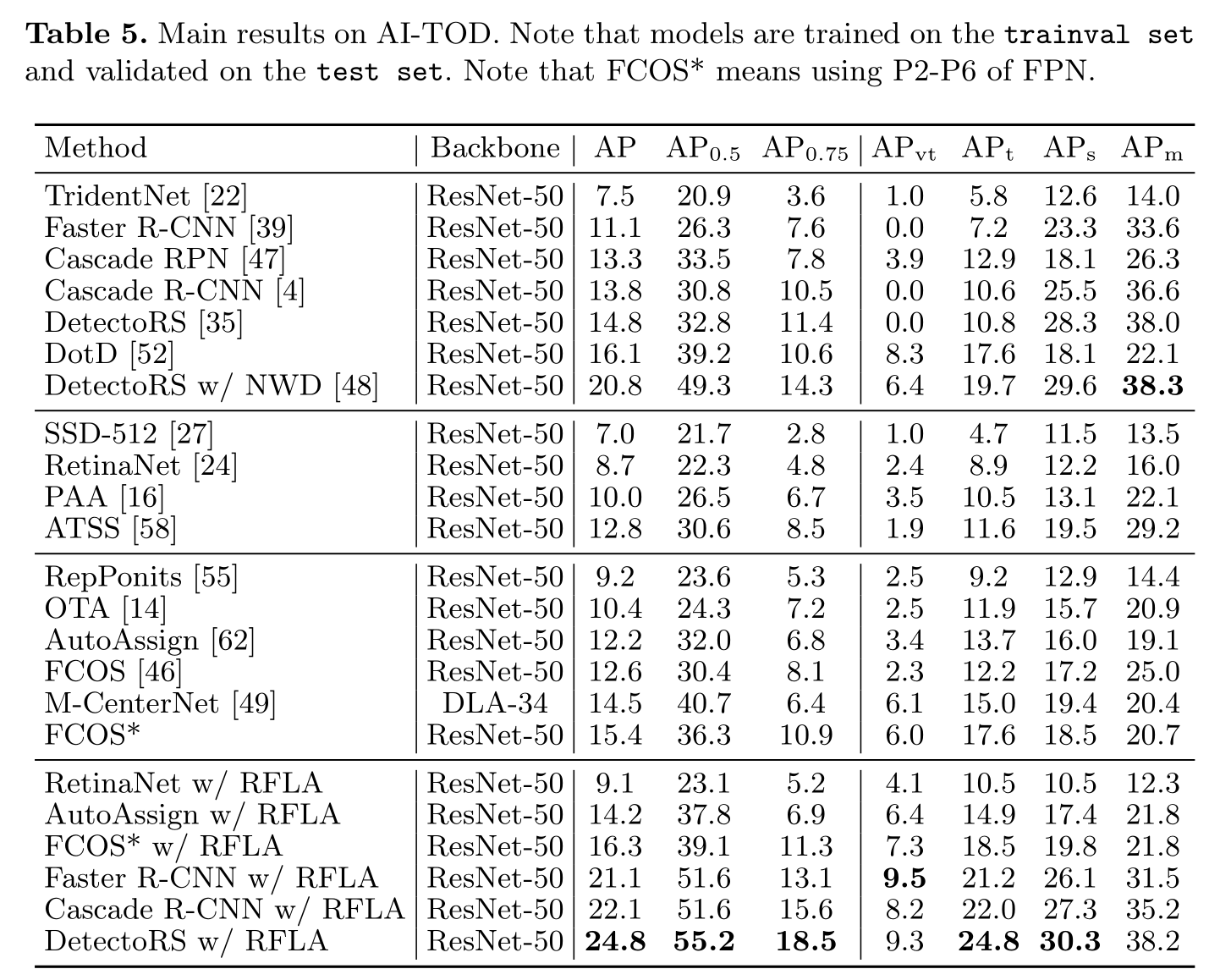

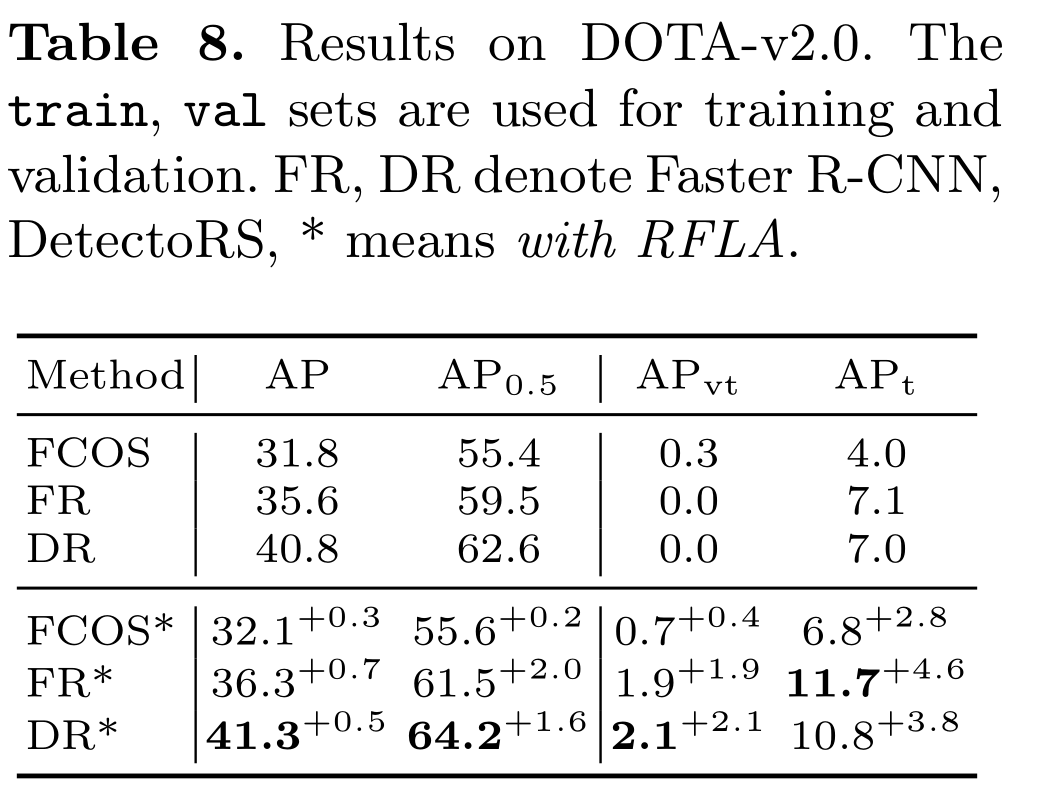

表1说明了GIoU不如WD和KLD,可能是由于无法区分相互包含的盒子的位置,而KLD和WD性能相当

RFD相比于IoU极大的提升了准确度(可以解释为盒子先验的有限域导致锚点与gt之间的IoU非常低,许多gt无法与任何锚点匹配),在此基础上HLA可以进一步提高性能

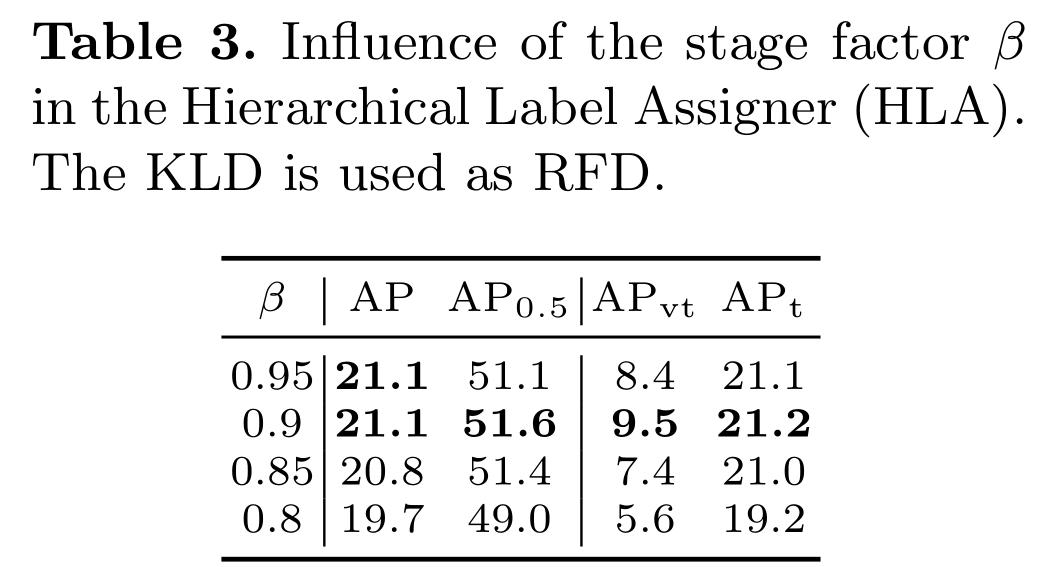

衰减因子β取值0.9时获得最佳效果,β较低时会带来很多低质量样本

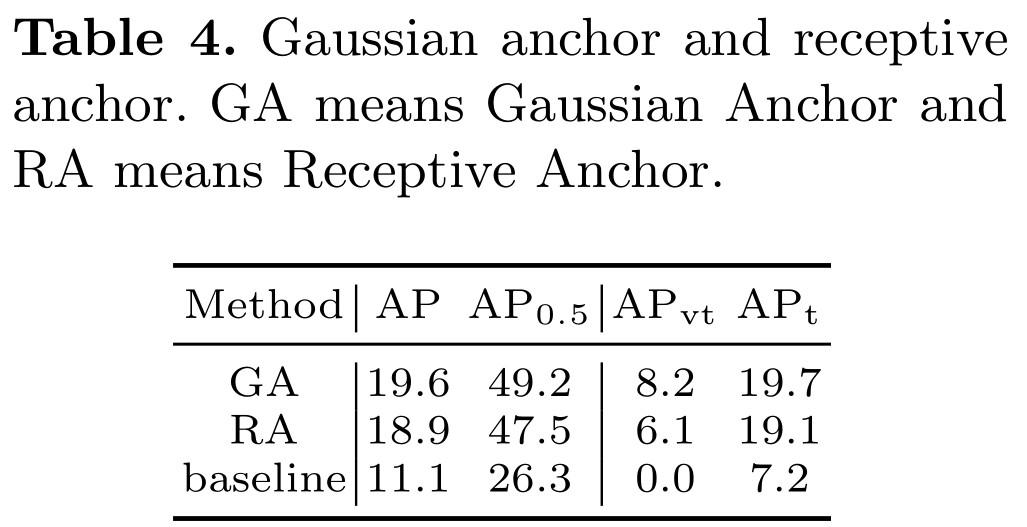

高斯先验及其与HLA的结合具有很大的优势,高斯先验具有更广泛的域,使样本补偿成为可能

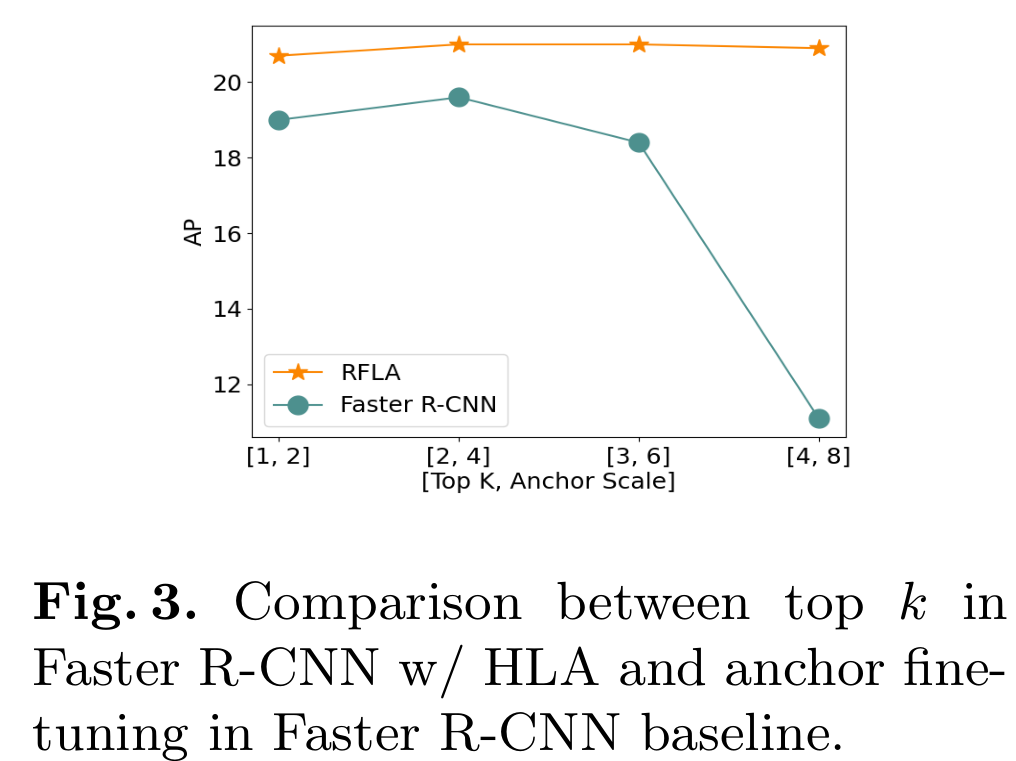

RFLA对k值选择具有鲁棒性

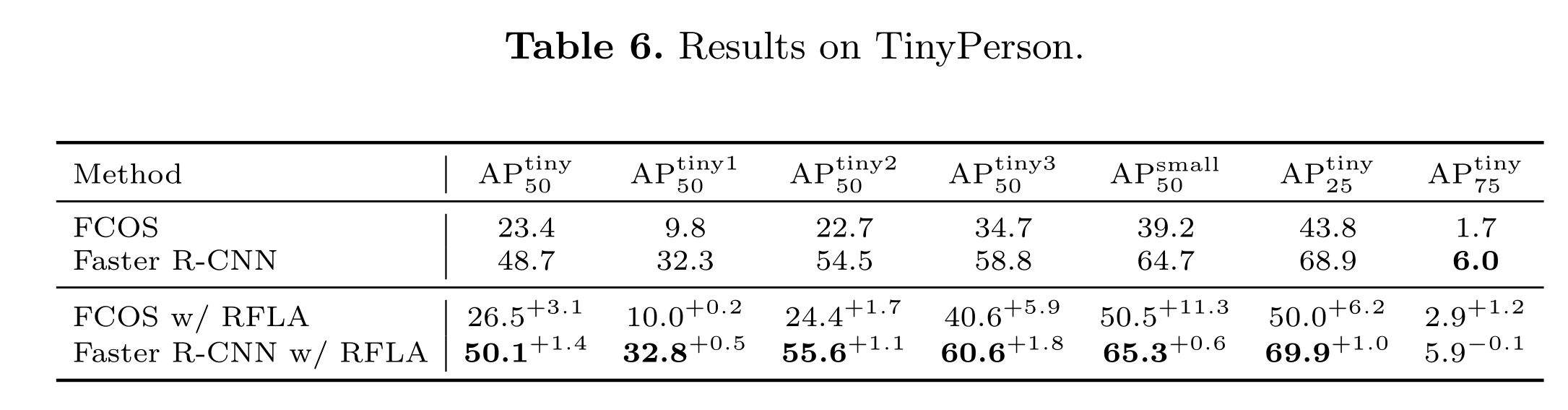

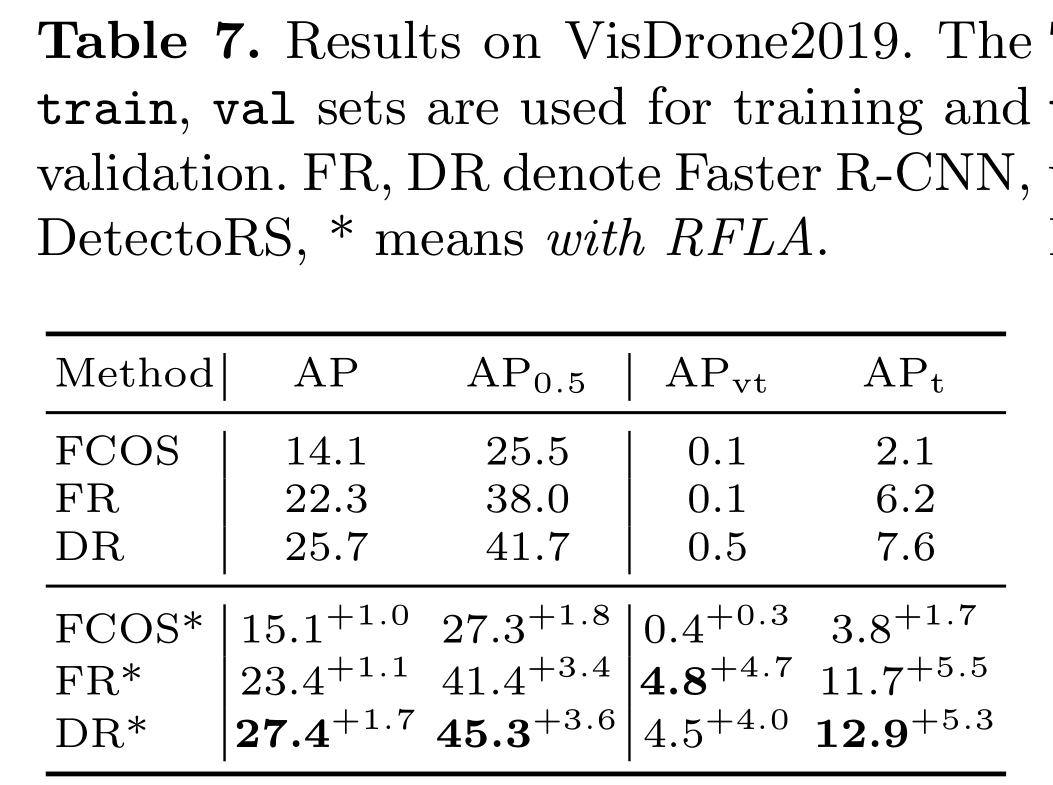

RFLA有效的解决了尺度样本不平衡问题,实现了对微小目标的平衡学习

RFLA对基于锚的多阶段检测器的改进尤为显著,作者认为这主要归功于多阶段检测器的二次观察和二次思考机制

Conclusion

在本文中,作者指出盒先验和点先验对TOD不适用,在分配标签时导致尺度-样本不平衡问题。为此,作者引入了一种新的高斯接受野先验。然后,作者进一步设计了一个新的感受野距离(RFD)来衡量ERF和gt之间的相似性,以克服IoU和TOD中心的不足。RFD与HLA策略协同工作,实现对微小对象的均衡学习

原文地址:https://blog.csdn.net/qihshe/article/details/136336884

免责声明:本站文章内容转载自网络资源,如本站内容侵犯了原著者的合法权益,可联系本站删除。更多内容请关注自学内容网(zxcms.com)!