神经网络基础原理

目录

神经网络基础

人工神经网络(ANN),简称神经网络(NN)。

经典神经网络结构包括三个层次:输入层、输出层以及隐藏层

每个圆圈代表一个神经元,隐藏层和输出层的神经元由输入的数据计算后输出,输出层的神经元只是输出

每个圆圈代表一个神经元,隐藏层和输出层的神经元由输入的数据计算后输出,输出层的神经元只是输出

神经网络特点

1)每个连接都有权值

2)同一层神经元之间没有连接

3)最后的输出结果对应的层称之为全连接层

感知机(早期基础)

不能解决复杂的问题

可以解决与问题:两个特征同时为1,结果为1

或问题:两个特征一个为1,结果为1

感知机是一种基础的分类模型,使用激活函数sign,感知机也有连接的权重和偏置

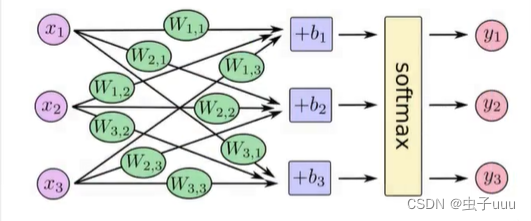

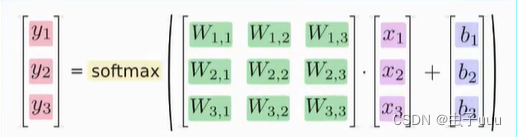

神经网络原理

神经网络解决多分类问题

softmax回归:将神经网络输出转换成概率结果

logits 加上softmax映射 ---多分类问题

怎样找到合适的模型参数?

构造损失函数(交叉熵损失)

公式:

减少损失,需要进行优化,提高对应目标值为1的位置输出概率大小

优化损失(TensorFlow中)

》tf.nn.softmax_cross_entropy_with_logits(labels=None,logits=None,name=None)

计算logits和labels之间的交叉损失熵

labels:标签值(真实值)

logits:样本加权之后的值

return:返回损失值列表

》tf.reduce_mean(input_tensor)

计算张量的尺寸的元素平均值

原文地址:https://blog.csdn.net/weixin_47256446/article/details/137835547

免责声明:本站文章内容转载自网络资源,如本站内容侵犯了原著者的合法权益,可联系本站删除。更多内容请关注自学内容网(zxcms.com)!