SAM+无监督学习!能发顶会的高端局组合!idea效果绝佳

学过SAM的朋友都知道,SAM需要对训练数据进行全面的手动标记,每张图像都要超过20分钟...效率有待提升。那么如何解决这个短板?我们考虑SAM+无监督学习。

这是因为无监督学习具有无需人工标注数据的特点,通过将两者结合,我们就可以在资源有限或标注成本较高的情况下,更有效地处理数据,同时不损失性能。

因此在很多领域,特别是医学图像分割等,这种高效、灵活又强大的数据处理和模式识别方法是我们的首选,自然也成了研究热点,相关成果效果绝佳,比如开创数据零标注时代先河的UnSAM,以及CVPR 2024的UnSAMFlow。

除此以外,还有一些很值得学习的无监督学习+SAM新方法,我从中挑选了9篇,简单提炼了可参考的创新点,希望可以给同学们提供论文灵感。

论文原文+开源代码需要的同学看文末

Segment Anything without Supervision

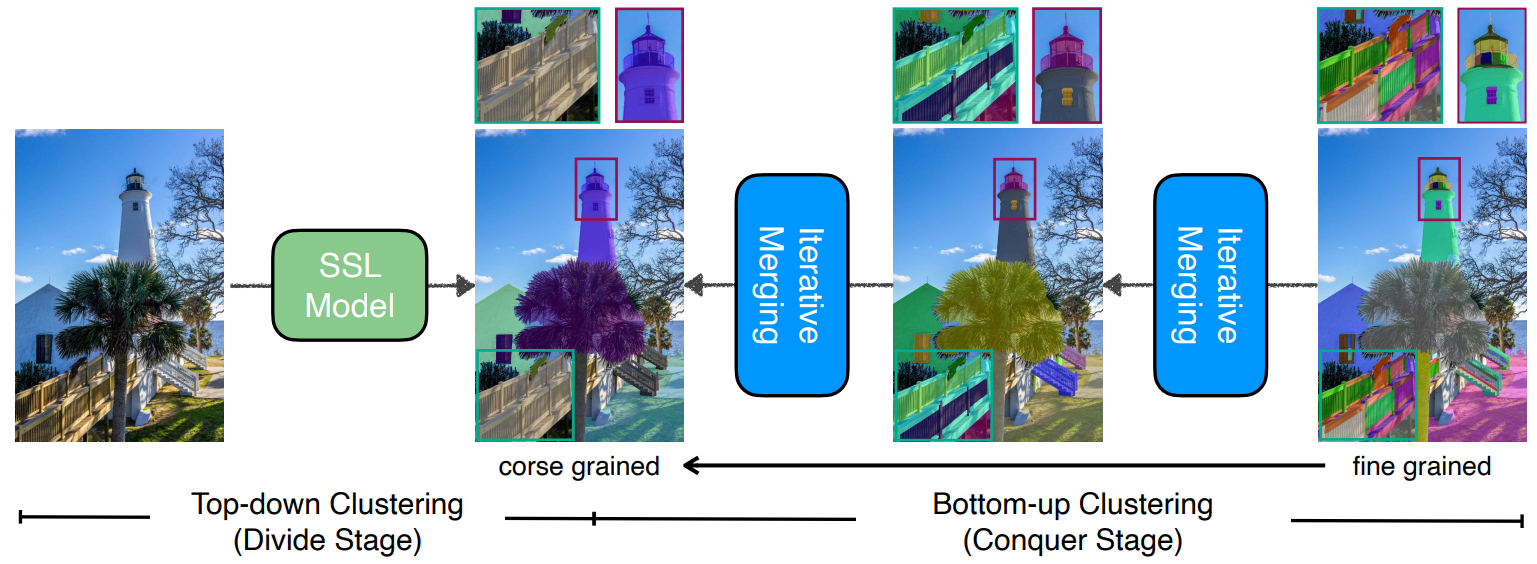

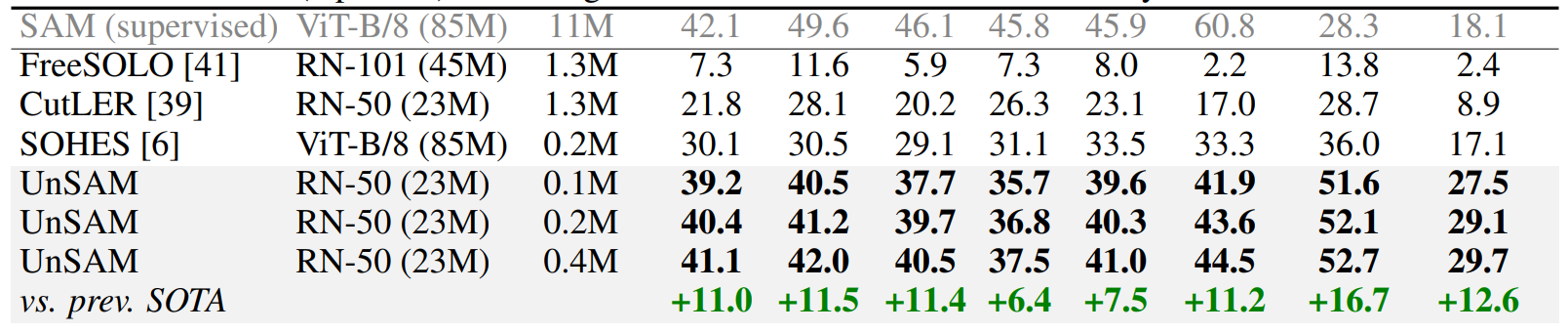

方法:本文介绍了一种名为UnSAM的无监督学习方法,能够在没有监督的情况下进行交互和整图分割。UnSAM采用了一种分而治之的策略来“发现”视觉场景的层次结构,利用自上而下的聚类方法将未标记的图像分割成实例/语义级别的区域,然后使用自下而上的聚类方法迭代地将像素合并成更大的组,形成层次结构。

创新点:

-

UnSAM:一种无监督学习方法,能够进行交互式和整图分割,无需监督。

-

UnSAM+:通过将无监督分割的结果与有监督分割的结果相结合,提高了有监督模型SAM的性能。

-

UnSAM通过一种分割策略,从原始未标记的图像中直接生成层次化的图像分割结果,实现了细粒度和多粒度的分割掩码,比以前的方法在无监督分割方面取得了显著的性能提升。

UnSAMFlow: Unsupervised Optical Flow Guided by Segment Anything Model

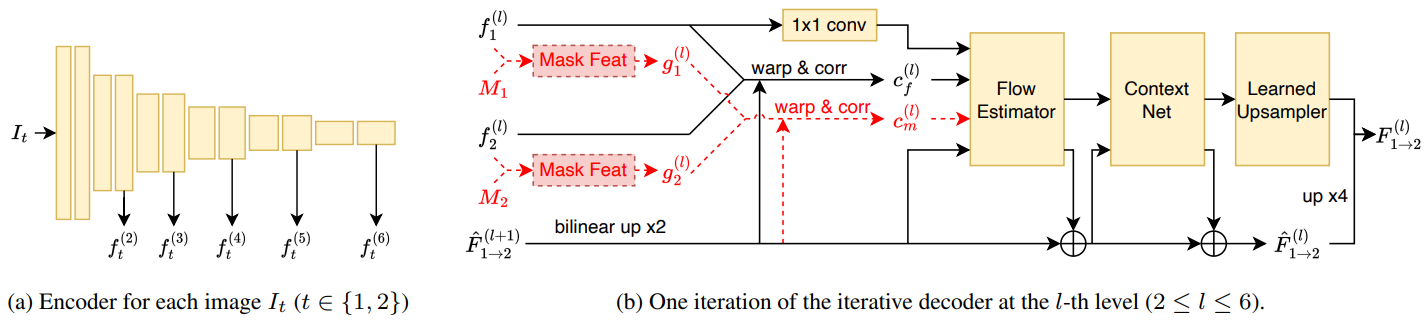

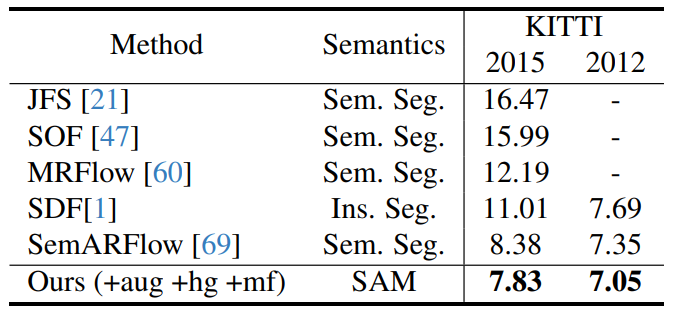

方法:本文提出了一种名为UnSAMFlow的无监督光流网络,结合SAM的目标信息,通过语义增强、单应性平滑损失和掩码特征模块等创新调整,显著提升在KITTI和Sintel数据集上的性能,实现了无监督方法的最新成果,同时展示出跨领域的良好泛化能力。

创新点:

-

提出了一种基于单应性的区域平滑损失,解决了传统边界感知平滑损失的局限性。

-

通过使用单应性平滑损失,生成非局部梯度,强制区域内的流动一致性,大大提升了训练优化的效果。

-

利用SAM的输出进行自监督语义增强,有效提升了无监督光流网络的表现。

-

通过引入掩码特征模块,聚合对象级特征,提高了光流估计的鲁棒性和清晰度。

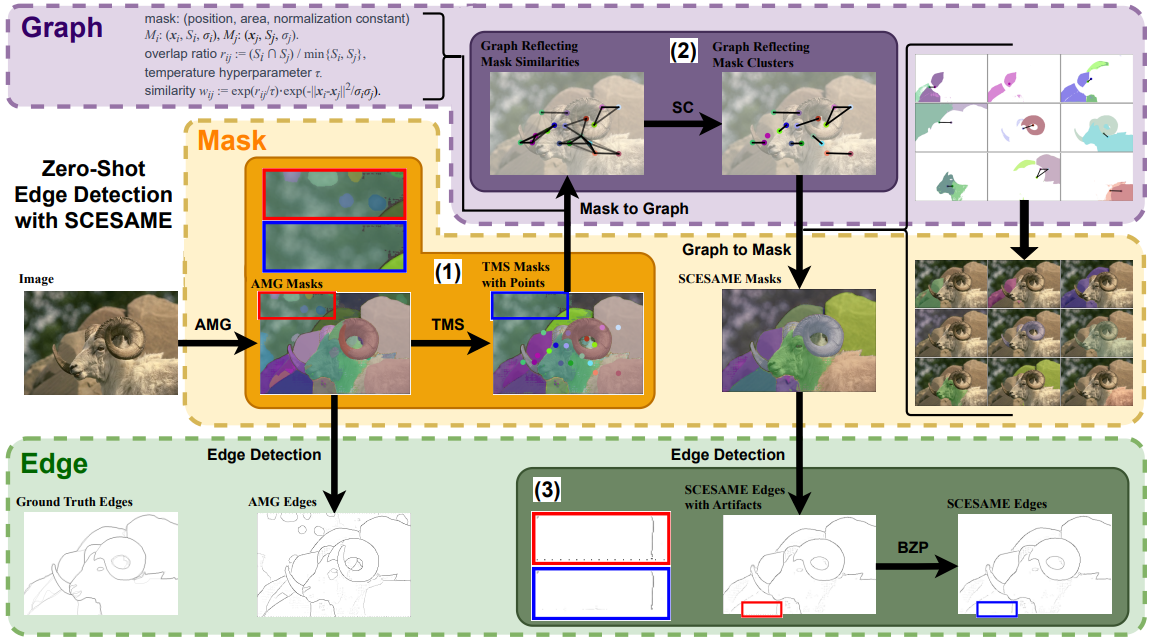

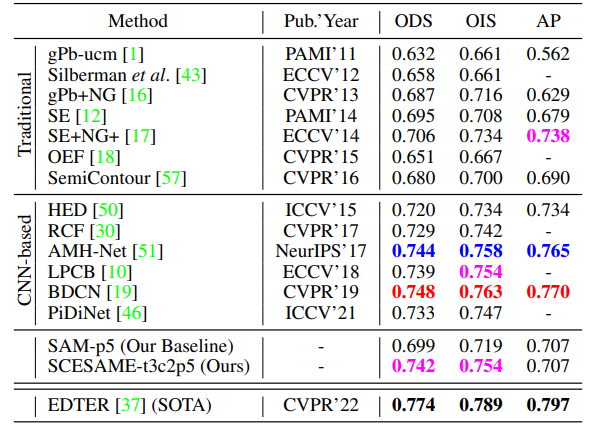

Zero-Shot Edge Detection with SCESAME: Spectral Clustering-based Ensemble for Segment Anything Model Estimation

方法:论文提出了一种基于无监督学习方法和SAM的边缘检测技术,通过消除小噪声掩码、结合光谱聚类合并掩码以及去除边界伪影,解决了AMG边缘过度检测的问题。

创新点:

-

SCESAME通过结合谱聚类技术,优化了Segment Anything Model (SAM)在自动掩膜生成(AMG)中的应用,解决了过度检测问题。

-

引入边界零填充(BZP)策略,专门用于消除由于掩膜边界而引起的边界伪影。该步骤在边缘检测后处理阶段,通过将图像边界附近的像素填充为零,显著提高了检测精度。

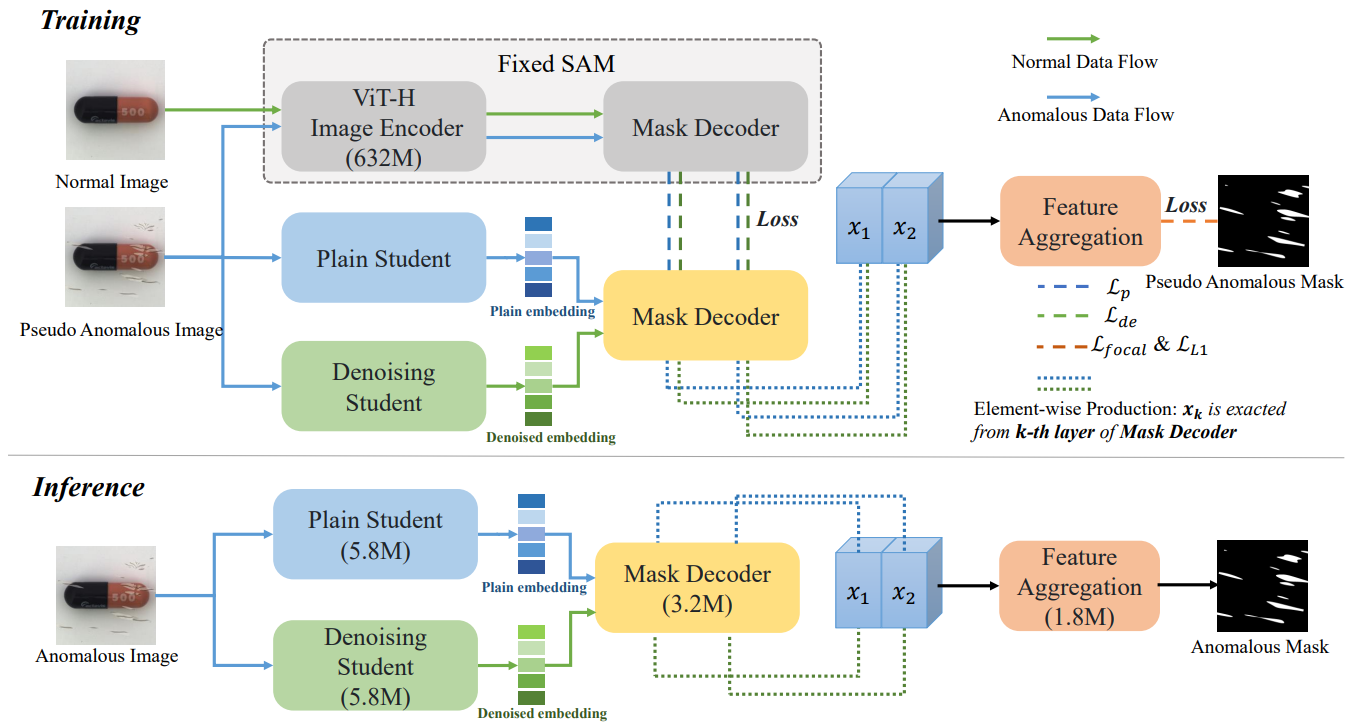

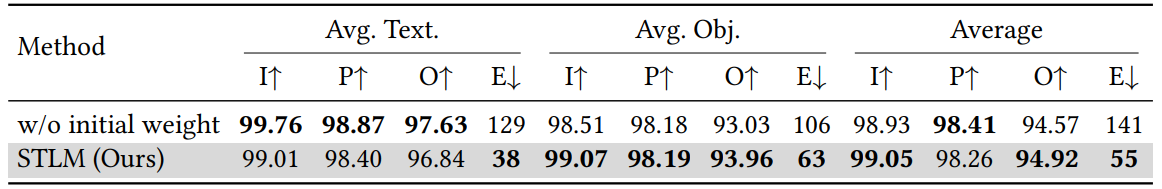

A SAM-guided Two-stream Lightweight Model for Anomaly Detection

方法:论文使用无监督学习方法,结合了SAM来指导两个轻量级流(Two-stream)进行异常检测,通过两流模型从固定的SAM中提取不同信息,一流生成区分性特征,另一流重建正常图像,在MVTec等数据集上实现具有竞争力的检测效果。

创新点:

-

提出了一种SAM指导的双流轻量级模型(STLM)用于无监督异常检测。

-

设计一个共享的掩码解码器和特征聚合模块,以显著减少网络的计算量和参数数量,提高推理速度。

-

引入伪异常生成策略,通过在正常训练图像上添加伪异常,平衡正常与异常图像的数量。通过一个固定的SAM教师网络指导训练,将其知识蒸馏到双流轻量级模型中,有效提升异常区域的区分能力。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“无监督SAM”获取全部论文+开源代码

码字不易,欢迎大家点赞评论收藏

原文地址:https://blog.csdn.net/weixin_42645636/article/details/142497941

免责声明:本站文章内容转载自网络资源,如本站内容侵犯了原著者的合法权益,可联系本站删除。更多内容请关注自学内容网(zxcms.com)!