论文笔记:How Can Large Language Models Understand Spatial-Temporal Data?

arxiv 202401

1 intro

- LLM在NLP和CV领域表现出色,但将它们应用于时空预测任务仍然面临挑战,主要问题包括:

- 数据不匹配

- 传统的LLMs设计用于处理序列文本数据,而时空数据具有复杂的结构和动态性,这两者之间存在显著差异

- 模型设计限制

- 现有的时空预测方法通常需要为特定领域设计专门的模型,这限制了模型的通用性和适应性

- 数据稀缺和泛化能力

- 传统的时空预测方法在面对数据稀缺或稀疏的情况下表现不佳,且泛化能力有限

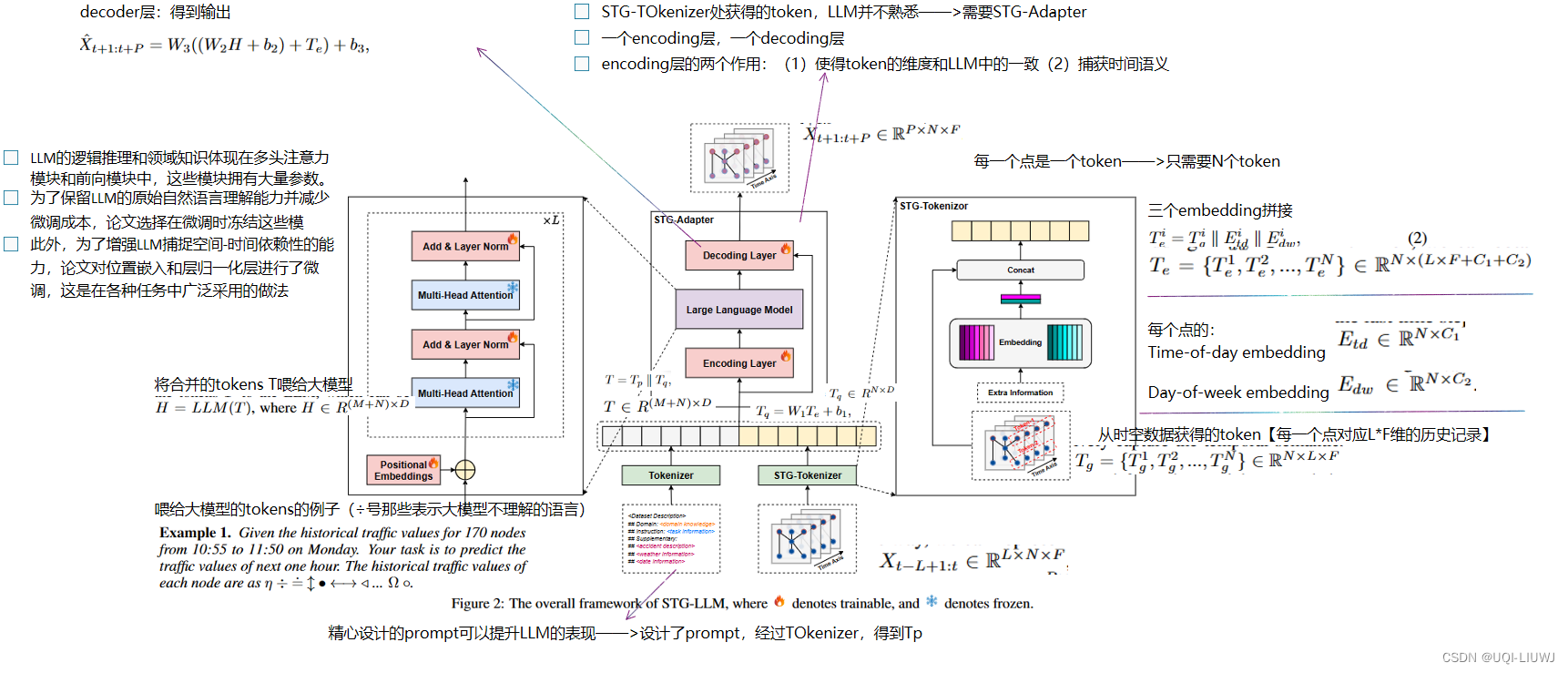

- ——>论文提出了STG-LLM(Spatial-Temporal Graph-Large Language Model)

- STG-Tokenizer

- 时空图(graph)标记器(Tokenizer)

- 将复杂的图数据转换为简洁的tokens,这些token能够捕捉空间和时间关系

- STG-Adapter

- 轻量级的适配器,包含线性编码和解码层,用于在LLMs和token化数据之间架起桥梁

- 通过微调少量参数,使LLMs能够理解由STG-Tokenizer生成的token的语义,同时保留LLMs原有的自然语言理解能力

- STG-Tokenizer

- 数据不匹配

2 LLM+时空的几种可能方法

3 论文方法

4 实验

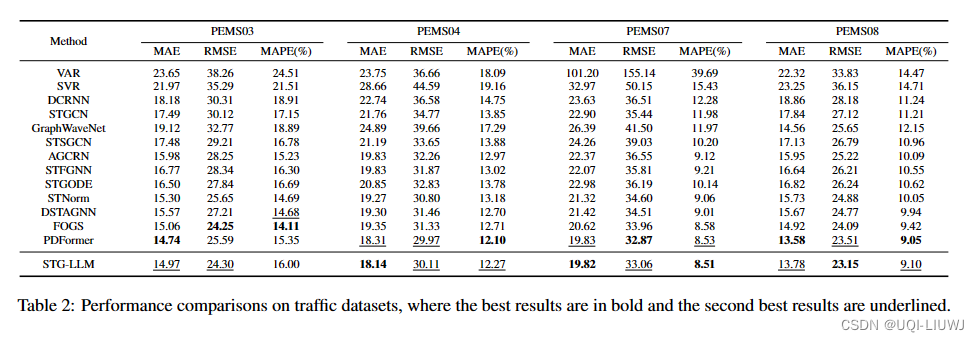

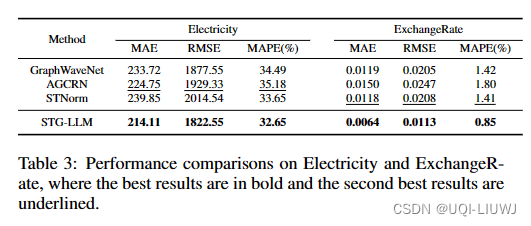

4.1 supervised比较

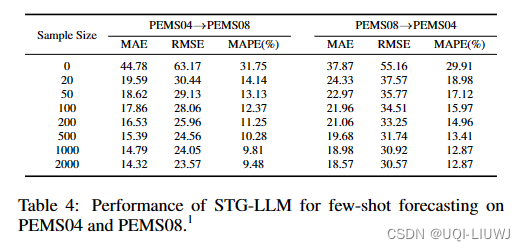

4.2 few shot 迁移能力

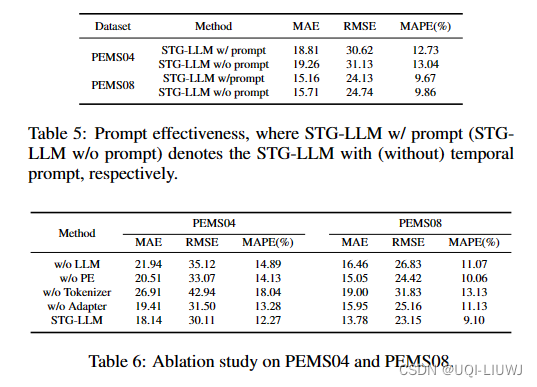

4.3 ablation study

原文地址:https://blog.csdn.net/qq_40206371/article/details/138018225

免责声明:本站文章内容转载自网络资源,如本站内容侵犯了原著者的合法权益,可联系本站删除。更多内容请关注自学内容网(zxcms.com)!