从CVPR 2024看 NeRF 最新改进&应用

三维重建领域必不可少的NeRF技术最近又有新突破了!

首先是SAX-NeRF框架,专为稀疏视角下X光三维重建设计,无需CT数据进行训练,只使用 X 光片即可,等于给NeRF开透视眼!

还有清华提出的GenN2N,一个统一的生成式 NeRF-to-NeRF 转换框架,适用于各种 NeRF 转换任务,在编辑质量、多样性、效率等方面都超越了SOTA!

这两篇都被收录于CVPR 2024,其中GenN2N更是获得了高分!值得一提的是本届 CVPR 录用论文中关于 NeRF 的论文数目也十分可观。

可见NeRF确实是一项创新且极具潜力的技术,它通过深度学习和体素渲染方法,实现了高度逼真的三维重建与视图合成,目前在自动驾驶、医学图像等领域都有非常广泛的应用。

为帮助大家快速了解并掌握最新的进展,我挑选了 CVPR 2024 有关 NeRF 改进与应用的研究成果 28 篇,希望可以给各位的论文添砖加瓦。

论文原文+开源代码需要的同学看文末

NeRF 改进

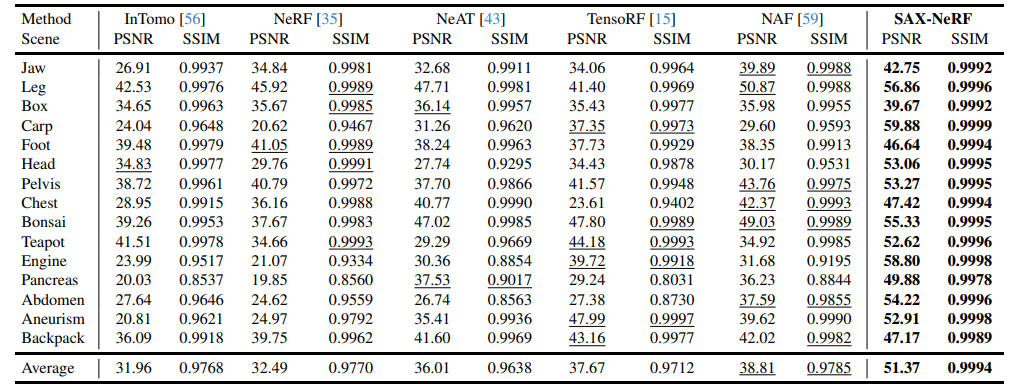

Structure-Aware Sparse-View X-ray 3D Reconstruction

方法:在本文中,作者研究了稀疏视图X射线三维重建中的一个核心问题,即如何有效捕捉被X射线穿透的各种复杂结构,为此作者提出了一个新的框架SAX-NeRF。

为了在空间中建模三维结构的依赖关系,作者设计了一个Transformer骨干网络Lineformer,将X射线分割成不同的线段,并在每个线段内计算自注意力。此外,为了提取投影中的2D几何和上下文表示,作者提出了一个包含像素级和补丁级采样的MLG射线采样策略。

创新点:

-

提出了一种新颖的方法SAX-NeRF,用于没有CT数据进行稀疏视图X光3D重建的训练。

-

设计了一种新的Transformer模型Lineformer,用于捕捉成像物体在3D空间中的复杂内部结构。

-

设计了一种MLG采样策略,用于提取2D投影中物体的几何和上下文信息。

-

建立了一个更大规模的基准数据集X3D,用于X光3D重建。

-

实验证明该方法在不同X光应用场景的NVS和CT重建任务上,性能超越SOTA。

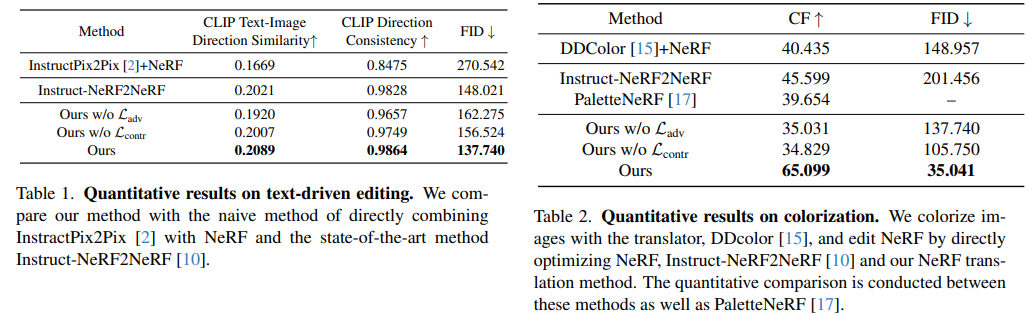

GenN2N: Generative NeRF2NeRF Translation

方法:本文介绍了GenN2N,这是一个统一的NeRF-to-NeRF转换框架,可以实现一系列的3D NeRF编辑任务,包括文本驱动编辑、上色、超分辨率和修复等。通过GenN2N,可以在推理时呈现编辑后的NeRF场景的至少两个渲染视图,生成具有适当的多视角一致性的高质量编辑结果。

创新点:

-

GenN2N使用2D到2D的图像翻译器进行2D编辑,并将结果整合到3D NeRF空间中,以确保3D一致性。

-

提出了一个3D VAE-GAN框架,可以学习与一组输入编辑的2D图像相对应的所有可能的3D NeRF编辑的分布。利用对抗学习和对比学习技术,可以将3D编辑和2D相机视角从编辑图像中解耦合。

NeRF 应用

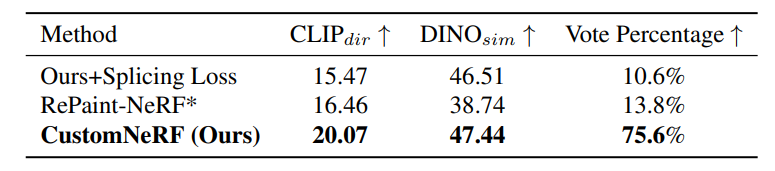

Customize your NeRF: Adaptive Source Driven 3D Scene Editing via Local-Global Iterative Training

方法:本文提出了一个统一的框架CustomNeRF,支持自适应源驱动的三维场景编辑,其中采用了一个主题感知的文本到图像(T2I)模型来将参考图像中的特定视觉主题V *嵌入到混合提示中,满足一般和具体的编辑要求。

创新点:

-

提出了CustomNeRF模型,用于自适应源驱动的三维场景编辑,可根据文本或参考图像进行统一的编辑提示。通过解决确保仅对前景进行编辑和在使用单视图参考图像时保持多视图一致性这两个关键挑战,实现了精确的编辑。

-

提出了一种类别引导正则化方法,利用T2I模型中的类别先验信息,以缓解图像驱动编辑中的Janus问题。

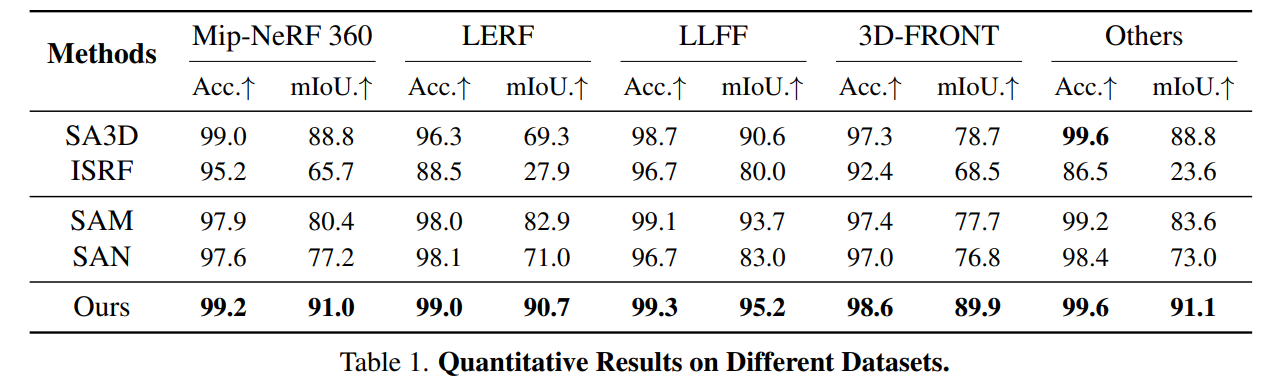

SANeRF-HQ: Segment Anything for NeRF in High Quality

方法:本文介绍了高质量3D分割的SANeRF-HQ框架,通过结合SAM和NeRF方法,实现对给定场景中任何目标物体的高质量3D分割,并在多个NeRF数据集上进行了定量和定性评估,展示了SANeRF-HQ在NeRF物体分割方面的优势,并展示了将该方法拓展到4D动态NeRF的潜力。

创新点:

-

提出了SANeRF-HQ框架,结合了SAM和NeRF的优势,实现了高质量的三维分割。

-

研究了在NeRF中实现高质量三维对象分割的方法,提出了SANeRF-HQ框架作为该领域的首次尝试。该方法在分割边界的准确性和多视角一致性方面取得了显著的进展。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“CVPR神经”获取全部论文+开源代码

码字不易,欢迎大家点赞评论收藏

原文地址:https://blog.csdn.net/weixin_42645636/article/details/140186979

免责声明:本站文章内容转载自网络资源,如本站内容侵犯了原著者的合法权益,可联系本站删除。更多内容请关注自学内容网(zxcms.com)!